Dùng AI tạo video giả: Hậu hoạ khôn lường

Tháng 6/2025, mạng xã hội Việt Nam một lần nữa xôn xao khi xuất hiện hàng loạt video “giả mà như thật”. Từ hình ảnh của người nổi tiếng phát biểu điều chưa từng nói, cho đến việc người dùng bình thường bị gán ghép vào các video nhạy cảm - tất cả đều được tạo nên bởi trí tuệ nhân tạo (AI) với mức độ chân thật đến rùng mình.

Deepfake: Từ công cụ sáng tạo đến vũ khí lừa đảo

Deepfake là công nghệ giả mạo khuôn mặt và giọng nói. Có thể hiểu là tạo ra một nhân vật ảo có khuôn mặt và giọng nói giống như người thật.

Với sự phát triển của các mô hình như GAN (Generative Adversarial Networks) và công nghệ tổng hợp giọng nói (TTS - Text to Speech), việc tái tạo hình ảnh và giọng nói trở nên dễ dàng hơn bao giờ hết. Chỉ cần một chiếc điện thoại thông minh và vài ứng dụng miễn phí, bất kỳ ai cũng có thể tạo ra một video “giả” nhưng trông rất “thật.

Về mặt tích cực, công nghệ này đang được ứng dụng trong điện ảnh (hồi sinh hình ảnh của các diễn viên đã qua đời), giáo dục (thuyết minh tự động), chăm sóc khách hàng (tổng đài AI) và cả y học (hỗ trợ người mất đi giọng nói). Tuy nhiên, điểm đáng lo ngại là sự dễ dãi trong việc tiếp cận và thao túng công cụ này đang dẫn đến nguy cơ bị lạm dụng cho các hành vi phi đạo đức, thậm chí vi phạm pháp luật.

Mối nguy hiểm tiềm tàng trong xã hội

Theo khảo của Hiệp hội An ninh mạng quốc gia (NCA) thực hiện từ ngày 28/11 đến 14/12/2024 với hơn 59.000 người tham gia, tổng thiệt hại do lừa đảo trực tuyến trong năm 2024 ước tính lên tới 18.900 tỷ đồng.

Con số đáng báo động này cho thấy các hình thức lừa đảo bằng công nghệ cao - đặc biệt là deepfake không còn dừng lại ở mục đích giải trí hay tạo hiệu ứng viral. Thay vào đó, chúng đang trở thành mối đe dọa nghiêm trọng đối với niềm tin xã hội.

Chỉ cần một đoạn clip giả mạo khuôn mặt và giọng nói, một người có thể bị vu oan cho hành động chưa từng xảy ra. Một doanh nghiệp có thể mất trắng uy tín vì một “phát ngôn giả” lan truyền chóng mặt trên xã hội. Nguy hiểm hơn, công nghệ này đang bị lợi dụng để giả mạo người thân, gọi điện mượn tiền dẫn đến hàng loạt vụ lừa đảo tinh vi.

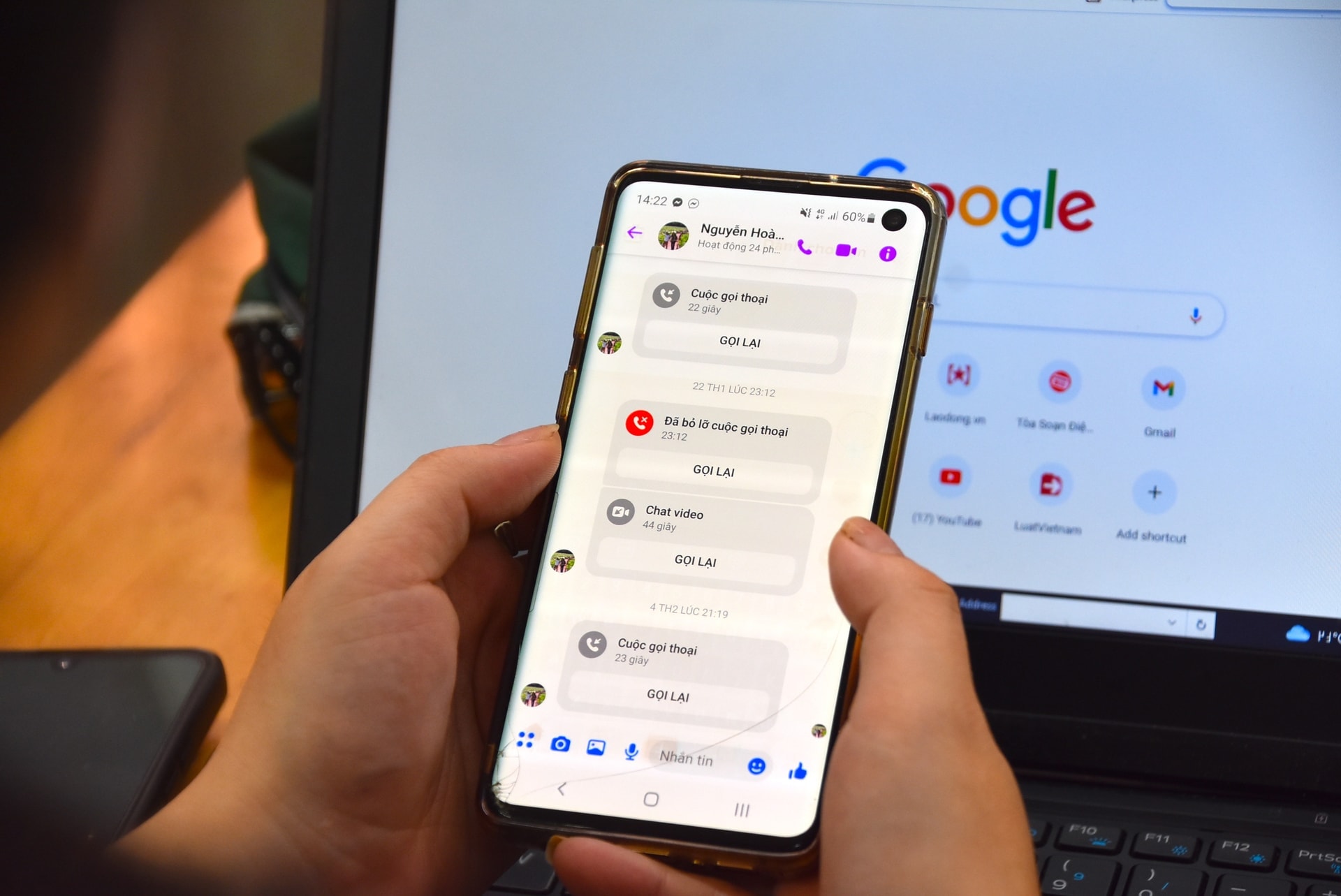

Cuối tháng 3/2025, bà T. trú tại quận Long Biên (Hà Nội) nhận được được cuộc gọi nhỡ từ tài khoản Viber của con gái. Khi gọi lại qua video call, bà thấy hiện lên hình ảnh quen thuộc của con mình nhưng cuộc gọi nhanh chóng bị ngắt với lý do “sóng yếu, hình ảnh kém”.

Ngay sau đó, tài khoản này tiếp tục nhắn tin thông báo đang cần tiền gấp để đổi ngoại tệ, hứa hẹn có chiết khấu cao. Tin tưởng tuyệt đối vào con gái, bà T. đã chuyển tiền theo hướng dẫn mà không kiểm tra lại. Tổng số tiền lên đến 1,3 tỷ đồng.

Chỉ đến khi nhận thấy toàn bộ tin nhắn trò chuyện trước đó bị xóa sạch, bà T. mới sinh nghi và liên hệ lại với con thì phát hiện tài khoản đã bị hacker chiếm quyền sử dụng. Ngay lập tức, bà đã đến trình báo với cơ quan công an.

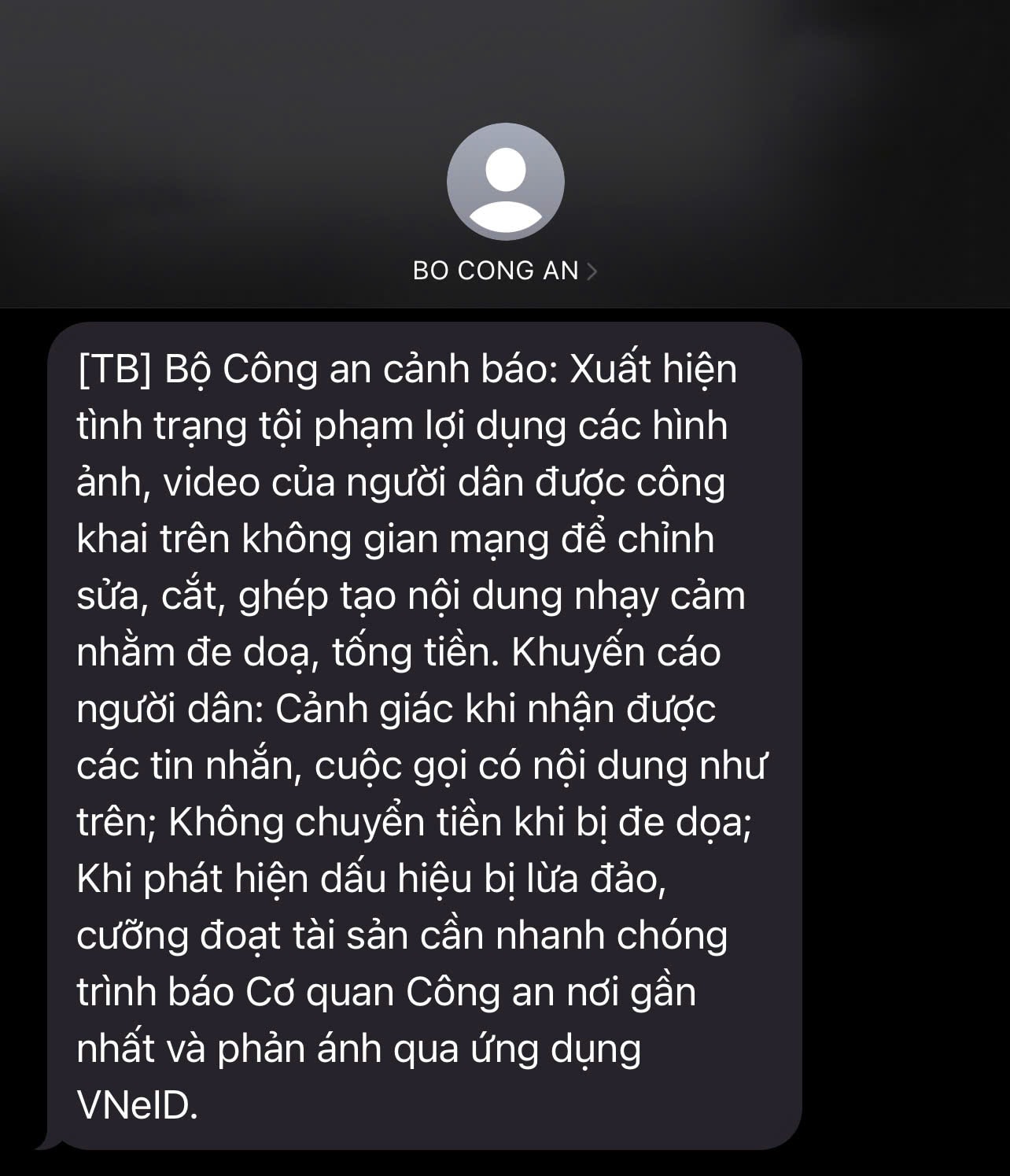

Điều đáng nói là hiện vẫn chưa có cơ chế kiểm duyệt đủ mạnh để phát hiện và ngăn chặn kịp thời các nội dung này. Tại Việt Nam, hiện chưa có quy định cụ thể về việc sử dụng công nghệ deepfake hoặc AI tạo giọng nói dù Bộ Thông tin và Truyền thông đã nhiều lần cảnh báo về nguy cơ lạm dụng công nghệ số gây rối loạn thông tin, nhưng việc xử lý các hành vi vi phạm vẫn gặp nhiều khó khăn do thiếu hành lang pháp lý rõ ràng.

Trên thế giới, nhiều quốc gia đã bắt đầu triển khai các biện pháp quản lý nhằm đối phó với sự bùng nổ của công nghệ deepfake. Trung Quốc là một trong những quốc gia đi đầu khi áp dụng Luật Bảo vệ Thông tin Cá nhân (PIPL) yêu cầu phải có sự đồng ý trước khi sử dụng hình ảnh, giọng nói hay dữ liệu cá nhân của người khác trong các nội dung do trí tuệ nhân tạo tạo ra.

Trong khi đó, Liên minh Châu Âu (EU) đã ban hành Đạo luật AI bằng cách quy định các nội dung được tạo bởi trí tuệ nhân tạo (đặc biệt là deepfake) bắt buộc phải có nhãn cảnh báo rõ ràng để tránh gây nhầm lẫn cho người xem.

Tại Hoa Kỳ, bang Tennessee gần đây đã thông qua Đạo luật ELVIS, cấm việc sử dụng trái phép hình ảnh và giọng nói của nghệ sĩ nhằm bảo vệ bản quyền và danh tiếng của cá nhân trước sự xâm phạm bởi công nghệ tổng hợp giọng nói.

Trong bối cảnh đó, Việt Nam - quốc gia có tốc độ phát triển internet và mạng xã hội hàng đầu khu vực không thể đứng ngoài cuộc. Việc xây dựng khung pháp lý cụ thể và chặt chẽ để kiểm soát công nghệ deepfake là điều cần thiết, không chỉ bảo vệ quyền riêng tư và danh dự công dân, mà còn giữ gìn niềm tin xã hội trong một không gian số ngày càng khó lường.

Hiện này, thách thức không chỉ còn đặt lên vai các cơ quan chức năng mà còn nằm ở mỗi cá nhân. Làm thế nào để trở thành người “tiêu thụ” nội dung số thông minh? Đây không còn là câu hỏi mang tính lý thuyết mà đã trở thành kỹ năng “sống còn” cần thiết.

Khả năng tư duy phản biện, thói quen kiểm chứng thông tin và sự cảnh giác trước những video “giật gân bất thường” chính là tấm khiên bảo vệ người dùng trước làn sóng dữ liệu giả đang ngày một tinh vi.